大模型训练 关键字列表

高性能GPU服务器架构分析(上篇)

在高性能GPU计算的领域内,关键组件如CPU、内存模块、NVMe存储设备、GPU以及网络适配器等通过PCIe(外设部件互连标准)总线或专门设计的PCIe交换机芯片实现高效顺畅的连接。

从“夕发朝至”到“智算为王”:智算平台成企业“大模型”时代成功关键

长期以来,人工智能与超级计算似乎是两个独立的领域。然而,随着大模型训练对算力需求的指数级增长,二者之间的界限逐渐模糊。并行科技董事长陈健一针见血地指出:“AI训练的本质就是超算,超算也并不仅仅是CPU的超级计算机。超算架构、以GPU为核心的算力平台成为大模型训练的必备基础设施。”

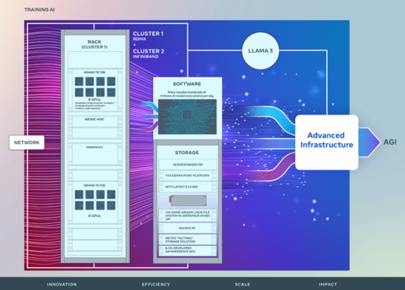

Llama-3公布基础训练设施,使用49,000个H100

Meta宣布了两个新的24K H100 GPU集群,用于训练大模型Llama-3,预计4月末或5月中旬上线。集群使用RoCEv2网络和基于Tectonic/Hammerspace的存储解决方案,支持PyTorch。

“源”大模型驱动,浪潮打造“智能客服大脑”

浪潮信息以全球领先的AI模型“源”为智能引擎,依托InService智能服务平台,构建了“智能客服大脑”,具备超强的语言理解、数据分析、自主学习和智能推理能力。