Qwen1.5-32B 关键字列表

2024-04-07

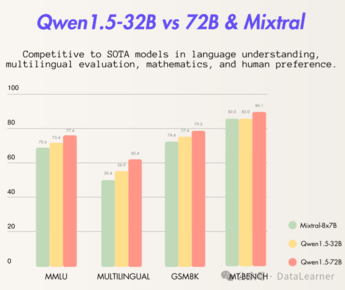

高产的阿里!Qwen1.5系列再次更新:阿里开源320亿参数Qwen1.5-32B,评测超Mixtral MoE,性价比更高!

阿里巴巴开源了320亿参数的大语言模型Qwen1.5-32B,性能略超Mixtral 8×7B MoE,略低于720亿参数的Qwen-1.5-72B。Qwen1.5-32B具有高性价比,显存需求减半,适合更广泛使用。模型在多项评测中表现优秀,特别是在推理和数学方面。支持32K上下文长度,以通义千问的开源协议发布,允许商用。